L’intelligenza artificiale fa già parte della vita di moltissimi cittadini di tutto il mondo. In questo momento storico infatti sono diverse le tecnologie, gli strumenti e i servizi che ricorrono a una o più branche dell’artificial intelligence: strumenti e servizi che costruiti sul machine learning, sul deep learning e/o sulle reti neurali.

Il risultato è che tantissime persone sfruttano l’intelligenza artificiale quotidianamente, anche senza rendersene conto; anche se magari, di fronte a una richiesta esplicita, non saprebbero spiegare l’intelligenza artificiale cos’è.

Proprio per questo è importante iniziare a conoscere in maniera più approfondita il funzionamento e le applicazioni di uno dei fenomeni scientifici più importanti del presente.

L’Intelligenza artificiale si presta infatti a utilizzi legati ai settori più disparati: si va quelli in ambito Vendite & Marketing a quelli in ambito Cybersecurity.

E, ancora, si va dalle applicazioni nella Logistica a quelle nella Sicurezza Pubblica e persino nella Sanità. Il tutto senza mai dimenticare che il fenomeno intelligenza artificiale continuerà a crescere, aumentando i suoi ambiti d’uso e, di conseguenza, caratterizzando sempre di più il futuro di tutti.

Un futuro all’insegna di nuove incredibili possibilità, ma anche di alcuni rischi in cui si potrebbe incappare, specie nel caso in cui l’intelligenza artificiale si continuasse a sviluppare senza adeguate forme di controllo.

- Cosa si intende e cos’è l’intelligenza artificiale

- Breve storia dell’intelligenza artificiale

- Intelligenza artificiale debole e forte: cosa sono e in cosa si distinguono

- Machine Learning e Deep Learning: cosa sono e differenze

- Reti neurali: come funziona l’intelligenza artificiale

- Esempi di intelligenza artificiale nei vari ambiti

- Intelligenza artificiale: scenari futuri e rischi

- Text to video: intelligenza artificiale ora genera video da un testo

- Intelligenza artificiale, i migliori generatori di immagini

- Google Bard, cos'è come funziona e come utilizzarla

- Intelligenza artificiale per pregare i Santi e parlare con Padre Pio

- Come usare Leonardo AI

- Cos'è Midjourney e come funziona

- Cos'è l'intelligenza artificiale generativa

- AutoGPT, cos'è e come funziona

- Robot umanoidi con intelligenza artificiale, nuova frontiera del lavoro?

- Come utilizzare Midjourney per l'UI/UX

- Come riconoscere un'immagine generata dall'intelligenza artificiale

- Human Generator, come creare immagini di persone con l'AI

- Applicazioni di Intelligenza Artificiale: il traduttore simultaneo e gli assistenti vocali smart

- Replika, cos'è e come funziona

- Come funzionano i Large Language Models

- Applicazioni di Intelligenza Artificiale: salute e benessere - health app, l'IA in medicina, sviluppo nuovi farmaci, farmaci intelligenti

- Che cos'è l'intelligenza artificiale multimodale e a cosa serve?

- Applicazioni di Intelligenza Artificiale: marketing & vendite - conosci il tuo cliente

- Intelligenza artificiale e Natural Language Processing

- Riconoscimento Facciale: come funziona e a cosa serve?

- Chatbot psicologo, l'IA può essere la risposta ai problemi di salute mentale?

- Come l'intelligenza artificiale rivoluziona la ricerca medica: il progetto Synthema

- IA e gaming, come cambierà il mondo dei giochi

-

0. Cosa si intende e cos’è l’intelligenza artificiale

.jpg)

Shutterstock

L’intelligenza artificiale è una particolare branca dell’informatica che si pone un obiettivo davvero molto ambizioso. Lo scopo ultimo dell’intelligenza artificiale infatti consiste nella progettazione e nell’elaborazione di sistemi, tanto hardware quanto software, capaci di donare prestazioni apparentemente umane a un elaboratore elettronico.

Come è facile intuire, non è affatto semplice catalogare dei criteri univoci che permettano di stabilire quanto il comportamento di un computer può essere considerato simile a quello di un essere umano.

Da questo punto di vista esistono infatti diversi approcci e diverse classificazioni specifiche, che aiutano a capire quando si possa effettivamente parlare di AI: un acronimo inglese che sta per artificial intelligence, ovvero intelligenza artificiale.

Ad esempio, si parla di AI nel caso in cui l’elaboratore sia in grado di agire umanamente, ovvero nel caso in cui il risultato di un’operazione compiuta da un sistema intelligente non possa essere distinto da quello raggiunto da un essere umano. E, ancora, è possibile parlare di intelligenza artificiale nel momento in cui l’elaboratore elettronico riesca a pensare umanamente, ovvero nel caso in cui risolva un qualunque problema ricalcando il processo di pensiero dell’essere umano.

Lo stesso discorso vale per il pensare razionalmente: un’ulteriore dicitura facente riferimento al processo che porterà sia l’elaboratore elettronico sia l’essere umano a risolvere il problema di cui sopra, rifacendosi alla logica. Ultimo, ma non ultimo, si parla di intelligenza artificiale nel caso in cui la macchina riesca ad agire razionalmente, ovvero nel caso in cui arrivi a ottenere il miglior risultato possibile, sulla base delle informazioni disponibili.

Oltre a capire l'intelligenza artificiale cos’è, occorre poi comprendere quali siano (o meglio, quante siano) le applicazioni possibili di questa disciplina. Lo sviluppo di machin learning, deep learning e reti neurali può infatti portare a risultati semplicemente straordinari.

Allo stesso tempo però, l’intelligenza artificiale genera da anni un dibattito che coinvolge sia gli scienziati che i filosofi e i sociologi. Diverse eccellenze del pensiero internazionale (una su tutte Stephen Hawking) hanno infatti più volte espresso dei dubbi in merito alla AI, mettendo il pubblico in guardia riguardo a tutta una serie di pericoli più o meno gravi che potrebbero derivare proprio da una sua crescita incontrollata.

-

1. Breve storia dell’intelligenza artificiale

Shutterstock

La storia dell’intelligenza artificiale è molto più antica di quanto non si potrebbe immaginare. Si consideri infatti che i primi esperimenti che hanno portato alla realizzazione di macchine in grado di effettuare calcoli matematici risalgono addirittura al XVII secolo. Detto questo, il primo modello di calcolatore concettualmente simile a quelli contemporanei è la cosiddetta “macchina analitica”: uno strumento prodotto dallo scienziato proto-informatico Charles Babbage, tra il 1834 e il 1837.

Se si parla di padri fondatori dell’artificial intelligence è poi impossibile non citare Alan Turing: un matematico, ma anche un filosofo che, nel 1936, pose le basi del concetto di “calcolabilità” e del concetto di “computabilità”.

Definizioni che risultano fondamentali ancora ai giorni nostri e che avrebbero permesso la realizzazione della celebre macchina di Turing: un modello astratto, che definiva una macchina capace di eseguire tutte le elaborazioni che potevano venire effettuate dai modelli di calcolo conosciuti all’essere umano.

La nascita ufficiale di una disciplina nota col nome di “intelligenza artificiale” sarebbe però arrivata soltanto vent’anni dopo: era infatti il 1956 quando il Dartmouth College del New Hamsphire organizzò un convegno da cui sarebbe uscita proprio l’espressione “intelligenza artificiale”.

Sempre in questa occasione, venne messo su un team di dieci persone a cui venne commissionata la realizzazione di una macchina che fosse capace di simulare i vari aspetti dell’intelligenza umana. Purtroppo però, per tutti gli anni ’50 e ’60 la Storia dell’AI sarebbe stata caratterizzata più da problemi e ostacoli che da successi: intanto perché anche gli scienziati più esperti erano ancora acerbi dal punto di vista della conoscenza semantica dei domini trattati da una macchina.

Ma soprattutto perché gli hardware allora disponibili non erano ancora in grado di ospitare tutta la memoria necessaria a immagazzinare una quantità sufficiente di dati e informazioni. Ci si scontrava dunque di fronte all’impossibilità di trasformare algoritmi funzionanti a livello teorico, in programmi capaci di calcolare effettivamente la soluzione proposta.

Non a caso, i primi sistemi di artificial intelligence utilizzati in ambito commerciale sarebbero arrivati soltanto nel 1982.

Sempre nel corso degli anni ’80 sarebbe poi stato interamente ripensato l’algoritmo per l’apprendimento delle reti neurali: un nuovo modello connessionista, che sostituì il precedente modello “simbolico”.

Da allora, l’intelligenza artificiale si è sviluppata in maniera impressionante, generando diverse branche come ad esempio il machine learning o il deep learning (uno specifico campo di ricerca del sopracitato “apprendimento automatico”).

La crescita dell’intelligenza artificiale va di pari passo con limiti e problematiche di natura sociale, culturale, etici e persino militari, inserite recentemente (nel 2017) in un vademecum promosso dal “Future of Life Institute” e sottoscritto da migliaia di esperti.

-

2. Intelligenza artificiale debole e forte: cosa sono e in cosa si distinguono

.jpg)

Shutterstock

Come visto in precedenza, per capire un’intelligenza artificiale cos’è bisogna innanzitutto riuscire a catalogare le diverse tipologie di azione o di funzione tipiche dell’essere umano, che un elaboratore dovrebbe essere in grado di replicare.

Azioni e funzioni che sono state storicamente organizzate all’interno di quattro macro-categorie: l’agire umanamente, il pensare umanamente, il pensare razionalmente e l’agire razionalmente. Questo insieme di classificazioni e considerazioni ha permesso poi all’artificial intelligence di dividersi ulteriormente all’interno di due grandi filoni di indagine, di ricerca e di sviluppo.

Il primo è quello dell’intelligenza artificiale debole, anche nota come weak AI o come artificial narrow intelligence. Questa definizione fa riferimento a tutti quei sistemi che siano in grado di simulare soltanto alcune specifiche funzionalità cognitive tipiche dell’essere umano, senza però riuscire a raggiungere una capacità intellettuale complessiva paragonabile a quella umana.

Si può dunque parlare di intelligenza artificiale debole quando si parla di programmi matematici capaci di problem solving. Allo stesso modo, si può parlare di intelligenza artificiale debole se l’elaboratore si concentra su un unico compito ristretto. È il caso, ad esempio, di tantissimi strumenti e/o servizi utilizzati quotidianamente al giorno d’oggi: da Google Assistant ad Amazon Alexa, da Siri a Translate.

Il secondo filone è invece quello dell’intelligenza artificiale forte, nota anche come strong AI o come artificial general intelligence. In questo caso si fa riferimento a dei veri e propri sistemi sapienti, che, in teoria, sono in grado di sviluppare un’intelligenza propria: un sistema di analisi e risoluzione dei problemi totalmente autonomo e che dunque non prevede l’emulazione delle capacità cognitive tipiche dell’essere umano.

Secondi alcuni scienziati la strong AI potrebbe portare alla realizzazione di macchine coscienti di sé. Secondo altri scienziati, una realizzazione compiuta dell’intelligenza artificiale forte potrebbe addirittura portare alla artificial super intelligence, ovvero al momento in cui le varie forme di AI supereranno l’intelligenza degli esseri umani.

-

3. Machine Learning e Deep Learning: cosa sono e differenze

Shutterstock

Proprio la distinzione tra il concetto di intelligenza artificiale debole e intelligenza artificiale forte aiuta a capire la differenza che esiste tra machine learning e deep learning: due ambiti di studio che rientrano nel campo dell’artificial intelligence e che, però, spesso vengono confusi l’uno con l’altro.

Ebbene, il machine learning (termine inglese, traducibile in italiano come “apprendimento automatico”) è una branca dell’AI che sviluppa modelli analitici pensati per permettere alle macchine di imparare nozioni e informazioni.

Il machine learning prevede che i dati di cui sopra portino l’elaboratore in questione a riuscire a prendere decisioni e ad effettuare predizioni, senza che sia stato direttamente istruito per farlo. Stiamo dunque parlando di un modello di apprendimento che mette la macchina nella condizione di adattarsi indipendentemente a eventuali nuovi set di dati, riuscendo così a risolvere un numero sempre maggiore (e sempre più complesso) di problemi.

Il deep learning (altro termine inglese, traducibile in italiano con “apprendimento profondo”) è invece uno specifico campo di ricerca del sopracitato machine learning: un insieme di tecniche che si basano sulle reti neurali e che permette un’elaborazione sempre più completa delle informazioni.

Il deep learning fa riferimento a specifici algoritmi che sono ispirati proprio alla struttura del cervello e alle sue differenti funzioni: algoritmi noti, per l’appunto, col nome di “reti neurali artificiali”. L’obiettivo del deep learning è duplice: da una parte punta a permettere alla macchina di apprendere autonomamente; dall’altra si pone l’obiettivo di permetterle di apprendere in maniera molto più profonda, avvicinandola sempre di più al regime dell’intelligenza artificiale forte.

Per approfondimento: Machine Learning e deep learning: intelligenze artificiali a confronto

-

4. Reti neurali: come funziona l’intelligenza artificiale

Shutterstock

In biologia, le reti neurali sono dei circuiti formati da neuroni: gruppi di unità cellulari che si occupano di funzioni fisiologiche specifiche. È grazie alle reti neurali che l’essere umano è in grado di compiere attività complesse: dal riconoscimento di suoni e immagini all’apprendimento nuove informazioni; dalla capacità di effettuare dei calcoli, a quella di pensare le proprie azioni.

Come già anticipato in precedenza, gli esperti di intelligenza artificiale si sono posti l’obiettivo di replicare il funzionamento del cervello umano e sono così arrivati allo sviluppo delle cosiddette reti neurali artificiali: dei particolari modelli matematici che vengono utilizzati per risolvere diversi problemi nell’ambito dell’artificial intelligence.

Anche le reti neurali hanno una storia molto più lunga di quanto non si potrebbe immaginare: il primo neurone artificiale infatti venne proposto addirittura nel 1943.

Da allora, ovviamente, la scienza ha fatto passi da gigante e proprio lo sviluppo delle reti neurali ha reso possibile un profondo ripensamento degli algoritmi alla base delle branche più avanzate dell’intelligenza artificiale (machine learning, deep learning ecc.).

Il sopracitato modello connessionista dell’AI si costruisce infatti proprio sopra l’interconnessione dei neuroni artificiali: più precisamente sul PDP, ovvero sull’elaborazione a parallelismo distribuito delle informazioni.

Le reti neurali sono in grado di modificare la loro struttura, ovvero i loro nodi e le loro interconnessioni, sulla base di dati esterni e/o di informazioni interne: dunque ricevono stimoli e reagiscono di conseguenza, proprio come le reti neurali biologiche (almeno da un punto di vista concettuale).

Una rete neurale, di base, è formata da tre strati principali, che possono coinvolgere anche decine di migliaia di connessioni ciascuno: lo strato degli ingressi, anche noto come strati I - Input, che riceve ed elabora il segnale in ingresso; lo strato nascosto, anche noto come strato H - Hidden, che si occupa dell’elaborazione; lo strato di uscita, anche noto come strato O - Output, che adatta il risultato dell’elaborazione alle richieste successive.

-

5. Esempi di intelligenza artificiale nei vari ambiti

Shutterstock

L'intelligenza artificiale ha un numero tale di possibili applicazioni che sarebbe semplicemente impossibile riassumerle tutte in poche righe. Detto questo, è comunque utile indicare, a mo’ di bullet points, per lo meno alcuni esempi di utilizzo contemporaneo di artificial intelligence, machine learning, deep learning e reti neurali. Già in questo momento storico infatti esistono diversi processi e/o sistemi che ricorrono alla AI e che magari molte persone utilizzano senza nemmeno rendersene conto.

Si pensi, in tal senso, al mondo delle Vendite e del Marketing e all’uso delle varie applicazioni di Recommendation: algoritmi che analizzano il comportamento degli utenti e che poi li guidano verso la finalizzazione di un acquisto.In alternativa, si pensi alla Sanità, alla Cybersecurity e alle applicazioni di Intelligent Data Processing: algoritmi utilizzati nell’ambito dell’analisi predittiva, ma anche in quello del rilevamento di eventuali elementi non conformi e/o di frodi.

E, ancora, si pensi alla Logistica: un settore che ricorre abitualmente all’intelligenza artificiale, sia per quello che riguarda la tracciabilità delle spedizioni, sia per quello che riguarda l’assistenza al cliente.

Diversi Virtual Assistant e/o Chatbot sono infatti in grado di compiere operazioni molto complesse (dalla memorizzazione di informazioni alla comprensione del tone of voice dell’utente) proprio grazie all’AI.

C’è poi la Sicurezza Pubblica, che utilizza tecnologie basate sull’artificial intelligence da ormai molto tempo: è il caso, ad esempio, dei processi di Image Processing e, più in generale, dei tanti software utilizzati nell’ambito della videosorveglianza.

Infine, parlare di intelligenza artificiale significa anche parlare di tanti strumenti e di tanti servizi che ormai sono entrati a far part della vita quotidiana di milioni di persone. Da questo punto di vista, basta pensare ai sistemi di traduzione simultanea o agli assistenti vocali smart: strumenti e servizi che, al giorno d’oggi, vengono dati per scontati, ma che in effetti sono stati resi possibili proprio dallo sviluppo dell’artificial intelligence.

Per approfondimento:Applicazioni di Intelligenza Artificiale, marketing e vendite: conosci il tuo cliente

-

6. Intelligenza artificiale: scenari futuri e rischi

Shutterstock

Quelli analizzati sin qui sono soltanto alcuni degli utilizzi possibili dell’intelligenza artificiale. Detto ciò, non va mai dimenticato che questo particolare ramo dell’informatica è in crescita continua: dunque è lecito immaginare che, in futuro, le applicazioni dell’AI continueranno ad aumentare in maniera esponenziale.

In tal senso, un primo aspetto da tenere in considerazione è l’evoluzione dei modelli di linguaggio e, più precisamente, del numero di parametri che saranno in grado di contare. Ad oggi i modelli più performanti riescono a contare quasi 2 bilioni di parametri, ma, in un futuro non troppo lontano, si potrebbe arrivare a modelli di linguaggio capaci di contare addirittura centinaia di bilioni di parametri. Una rivoluzione tecnologica che permetterebbe di gestire il linguaggio da parte delle macchine a un livello altissimo.

Parlare di evoluzione dell’artificial intelligence significa però anche parlare dei tanti rischi legati allo sviluppo di machine learning, deep learning e reti neurali.

In tal senso, una minaccia potenziale che già caratterizza il presente è quella legata alla diffusione di software capaci di creare i cosiddetti deepfake: delle sintesi di un’immagine umana, basate proprio sull’intelligenza artificiale.

La tecnica deepfake permette di sovrapporre immagini e/o video su modelli preesistenti con una verosimiglianza impressionante: ciò vuol dire, ad esempio, sostituire il volto di un qualunque essere umano con quello di qualunque altro.

Allo stesso modo, diverse autorità si stanno interrogando sull’opportunità di ricorrere al riconoscimento facciale dal vivo: un’applicazione figlia dell’AI, che però rischia di interferire con diritti e libertà individuali alla base di tante democrazie.

Per questi motivi e per tantissimi altri, è fondamentale che il progresso dell’intelligenza artificiale vada di pari passo con una discussione approfondita sui pro e i contro di questa tecnologia. Una discussione che metta la scienza nella condizione di progredire, ma che, al tempo stesso, ponga dei paletti, per tutelare la serenità e la sicurezza dei cittadini globali.

-

7. Text to video: intelligenza artificiale ora genera video da un testo

Shutterstock

Ormai gli appassionati di intelligenza artificiale sono abituati a tool che lavorano secondo un modello text to text piuttosto che secondo un modello text to image.

Si pensi in tal senso a ChatGPT o DALL-E, che generano output testuali e realizzano immagini inedite a partire da prompt scritti utilizzando il linguaggio naturale.

Ma oggi i tool AI sono pronti per un ulteriore salto tecnologico, che corrisponde alla modalità text to video, grazie a cui l’intelligenza artificiale genera video a partire da una richiesta testuale.

Runway è stata una delle prime AI text to video lanciate sul mercato: un tool fatto dagli artisti per gli artisti, perfetto sia per la creazione di video che per la creazione di podcast.

Runway e Modelscope rappresentano due esempi di intelligenza artificiale che opera attraverso il cosiddetto text to video.

Inoltre l’intelligenza artificiale di Runway può essere sfruttata anche per eseguire altre operazioni, come ad esempio quelle legate all’editing del video o del podcast generato.

Modelscope è un altro generatore video che si basa su un’intelligenza artificiale che offre modalità di interazione di tipo text to video. Anche in questo caso l’utente non deve fare altro che scrivere la propria richiesta, per ottenere un output in linea con le proprie aspettative, al di là di qualche limite tecnico.

D'altronde proprio la qualità rappresenta la principale sfida delle AI text to video: il primo obiettivo infatti è migliorare il livello delle animazioni, soprattutto nel caso di richieste dettagliate e complesse.

Allo stesso tempo i diversi tool saranno in grado di realizzare output sempre più corposi, sia dal punto di vista della durata che da quello della varietà di soluzioni e stili disponibili.

Per approfondimento: Text to video: intelligenza artificiale ora genera video da un testo

-

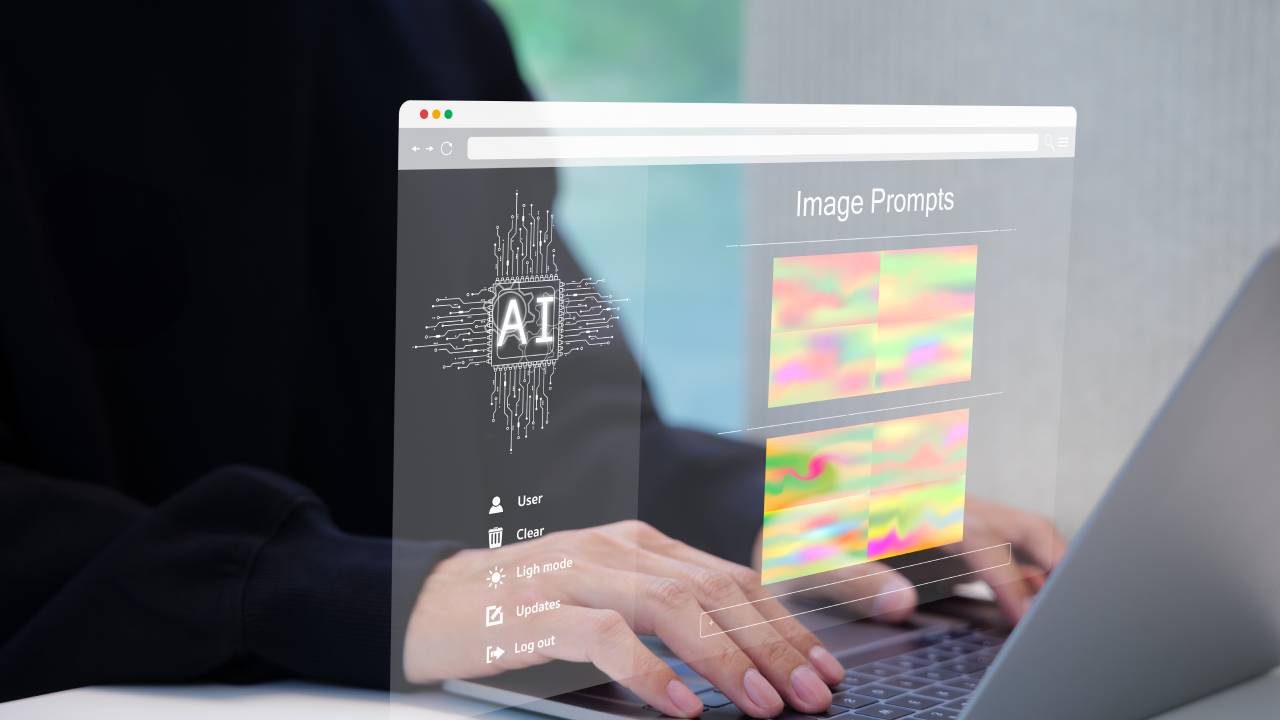

8. Intelligenza artificiale, i migliori generatori di immagini

Shutterstock

La generazione di immagini a partire da prompt testuali è uno dei terreni più battuti dai tool AI di questo periodo storico: si pensi in tal senso a DALL-E, Midjourney e Bing Image Creator, ma anche a Leonardo AI e Stable Diffusion.

I migliori generatori di immagini forniscono servizi concettualmente simili, ma si distinguono in base a tecnologie, modelli linguistici, condizioni e costi anche molto diversi tra loro.

DALL-E è uno degli strumenti più noti e apprezzati in assoluto quando si parla di generare immagini con l’AI. Il tool di per sé gratuito, ma senza un abbonamento a pagamento gli utenti possono utilizzarlo in maniera piuttosto limitata.

Uno dei principali punti di forza di DALL-E è la facilità d’uso, anche nel momento in cui si entra in operazioni di editing più avanzate: si pensi in tal senso all’aggiunta, ma anche alla rimozione di frame o elementi.

DALL-E, Bing Image Creator, Midjourney, Stable Diffusion e Leonardo AI sono solo alcuni dei migliori tool AI per la generazione di immagini.

Bing Image Creator può invece essere utilizzato gratuitamente, a patto di essere disposti a un uso limitato dei cosiddetti “boost”: delle accelerazioni che permettono al tool di eseguire le richieste dell’utente impiegando una minore quantità di tempo.

Anche Midjourney dispone di una prova gratuita, che limita l’utente all’inserimento di circa 25 prompt al mese. Per aumentare il numero di richieste e andare oltre i limiti della licenza non commerciale CC BY-NC bisogna sottoscrivere un abbonamento a pagamento.

Infine spazio anche a due soluzioni totalmente gratuite come Stable Diffusion e Leonardo AI. La caratteristica più distintiva di Stable Diffusion sta nella sua natura open source, ma a ciò si aggiunge la possibilità di scaricare ed eseguire il tool localmente. Leonardo AI invece si distingue soprattutto per la possibilità di continuare ad addestrare l’intelligenza artificiale caricando contenuti multimediali vari.

Per approfondimento: Intelligenza artificiale, i migliori generatori di immagini

-

9. Google Bard, cos'è come funziona e come utilizzarla

rafapress / Shutterstock.com

Gemini è la nuova intelligenza artificiale multimodale targata Google: un AI chatbot pensato per aiutare gli utenti in tutte le più importanti attività quotidiane, dalla sfera lavorativa a quella personale.

Gemini può essere considerato un successore o un’evoluzione di Google Bard: un primo progetto di chatbot sviluppato dal colosso di Mountain View, che comunque utilizzava un modello linguistico di nome Gemini.

L’interazione con il chatbot di Gemini è concettualmente simile a quella di altri competitor sul mercato: l’utente inserisce le proprie richieste scritte e il tool le analizza per poi restituire output diversi.

Google Gemini è infatti in grado di scrivere testi, così come è in grado di analizzare immagini. Può inoltre scrivere codice e aiutare l’utente in tantissime operazioni legate alla gestione e l’organizzazione di contenuti o, più in generale, legate alla produttività.

Google Gemini (ex Google Bard) è un AI chatbot in grado di rispondere a tantissime esigenze quotidiane degli utenti.

Usare Google Gemini (ex Google Bard) è semplicissimo: basta visitare la pagina ufficiale del tool, eseguire l’accesso con un account Google valido e accettare condizioni di utilizzo e policy sulla privacy.

A questo punto è possibile aprire una Nuova Chat e iniziare a interagire con l’AI chatbot attraverso prompt scritti in linguaggio naturale. Il livello di dettaglio del prompt va valutato in base al tipo di output che si desidera in restituzione.

È possibile chiedere a Gemini dei consigli generici legati ad argomenti vasti: si pensi in tal senso alle informazioni meteo, piuttosto che a un consiglio su cosa cucinare per cena.

Allo stesso tempo è possibile fare richieste molto più mirate e specifiche: ad esempio molti utenti utilizzano il tool per analizzare documenti complessi e riassumerli in pochi punti chiave.

Per approfondimento: Google Gemini, cos’è, come funziona e come utilizzarla

-

10. Intelligenza artificiale per pregare i Santi e parlare con Padre Pio

Shutterstock

Oggi l’intelligenza artificiale può essere utilizzata in ambiti e contesti semplicemente inimmaginabili nel passato più recente. Basti pensare che esistono tool sviluppati appositamente per accompagnare i fedeli: dalle preghiere del mattino alle preghiere della sera.

Per non parlare poi di quelli che permettono letteralmente di pregare i santi: a partire da Padre Pio, fino ad arrivare a Sant’Antonio, San Francesco, San Gennaro o Santa Rita.Prega.org è un celebre esempio di chatbot che segue la falsa riga di ChatGPT e che però permette espressamente di simulare una conversazione con un santo. Le prime personalità virtuali disponibili sono state realizzate per ricalcare i sopracitati Padre Pio, Sant’Antonio, San Francesco, San Gennaro e Santa Rita. Ma il servizio permette anche di richiedere lo sviluppo di altri interlocutori, tramite la compilazione di un form.

Prega.org è il chatbot AI che permette di pregare e addirittura interagire con alcuni santi come Padre Pio, ma non mancano le critiche.

Dopo avere effettuato l’accesso, gli utenti di Prega.org possono iniziare a interagire col chatbot come meglio credono. Ad esempio possono utilizzarlo per recitare un rosario, ma anche per essere accompagnati in preghiere ad hoc: dalle preghiere per la famiglia a quelle direttamente rivolte a un santo.

Le prime critiche a Prega.org parlano di un chatbot molto poco sviluppato dal punto di vista dell’AI. Il sistema infatti sembra limitarsi a proporre formule standard, senza arrivare mai a un livello di interazione reale e profonda con l’utente. Allo stesso modo le prime versioni di Prega.org non sono in grado di rispondere a domande specifiche che entrano nel merito di un output precedente.

Vanno poi considerate le perplessità di natura più etica che tecnologica. Molti fedeli infatti si interrogano sull’opportunità di utilizzare uno strumento di intelligenza artificiale per simulare una preghiera a Padre Pio piuttosto che una preghiera a Santa Rita.

Per approfondimento: Intelligenza artificiale per pregare i Santi e parlare con Padre Pio

-

11. Come usare Leonardo AI

Shutterstock

Leonardi AI è molto più di un tradizionale tool di intelligenza artificiale di tipo text to image. Anzi, è molto più di un semplice generatore di immagini, considerato che mette l’utente nella condizione di interagire con una specie di studio di produzione di contenuti.

L’intuizione dietro Leonardo AI consiste nell’applicare le soluzioni dell’intelligenza artificiale generativa al mondo dei videogiochi. L’utente infatti può utilizzare il tool per realizzare contenuti creativi pronti per essere mappati all’interno di un motore di gioco: dagli oggetti agli edifici, passando per i personaggi e addirittura gli ambienti.

Il tutto potendo contare sulla comodità del modello text to image e su un’interfaccia particolarmente user friendly. L’utente infatti non deve fare altro che scrivere la sua idea, lasciando all’AI il compito di realizzarla.

Per ottenere questo genere di risultato Leonardo AI utilizza particolari algoritmi di deep learning, che vengono applicati a una gigantesca library fatta di diversi modelli pre-addestrati.

Leonardo AI sfida i limiti di un semplice generatore di immagini text to image, offrendo all’utente uno studio di produzione molto più ricco.

In questo modo il tool è in grado di rispondere alle varie esigenze creative dell’utente, tenendo conto di stili diversi: da quello più fotorealistico a quello più astratto, dall’effetto mosaico al puntinismo.

Tra le funzionalità più meritevoli di menzione spicca l’editor AI Canvas, che permette di creare nuove immagini artistiche, ma anche di modificare e addirittura di fondere contenuti preesistenti. Molto apprezzata anche la prompt generation feature, che permette di realizzare concept diversi a partire da una semplice parola.

Nella prima fase di release, Leonardo AI è stata disponibile soltanto su invito, ma molti utenti hanno trovato un escamotage per abbreviare i tempi di attesa attraverso Discord: più precisamente unendosi al server proprietario della community.

Per approfondimento: Come usare Leonardo AI

-

12. Cos'è Midjourney e come funziona

Improvisor / Shutterstock.com

Quando si parla di Midjourney si pensa generalmente a un’intelligenza artificiale specializzata nella realizzazione di immagini. Ma in realtà il nome Midjourney è innanzitutto quello di un laboratorio di ricerca, che ha come principale progetto un generatore di immagini omonimo.

Volendosi soffermare su come funziona Midjourney AI, emergono schemi non troppo diversi da quelli di tool simili: l’utente inserisce la sua richiesta attraverso un prompt scritto e l’intelligenza artificiale lo usa come base per la realizzazione di un output.

Non si sa molto su come viene addestrata l’AI di Midjourney, ma diversi esperti concordano nel ritenere che il sistema sia simile a quello di DALL-E e Stable Diffusion: soprattutto per quello che riguarda i processi di “diffusione” e “denoising”.

Midjourney AI è un generatore di immagini che permette di creare contenuti inediti a partire da un semplice prompt testuale.

Durante la prima fase di release, Midjourney permetteva di registrarsi esclusivamente con un account Discord: una piattaforma che permette diverse opportunità di condivisione di contenuti, nata innanzitutto per la comunità dei videogiocatori.

Successivamente il team ha aperto la versione beta della sua intelligenza artificiale anche agli account Google e non è detto che, col passare del tempo, l’accessibilità venga allargata ad altre tipologie di utenza.

Midjoyrney AI è un tool molto apprezzato a livello internazionale, ma esistono anche diversi utenti che manifestano critiche più o meno pesanti verso il sistema: innanzitutto per l’assenza di filtri necessari a impedire la creazione di contenuti disturbanti, offensivi o politicamente scorretti.

A ciò si aggiunge il controverso tema del copyright, considerato che ad oggi chiunque può chiedere a Midjourney di partire da un’immagine protetta da diritto d’autore o dalla foto di una persona più o meno nota, senza aver bisogno di alcun tipo di consenso.

Per approfondimento: Cos'è Midjourney e come funziona

-

13. Cos'è l'intelligenza artificiale generativa

.jpg)

Shutterstock

Al giorno d’oggi si parla di tool come ChatGPT e DALL-E facendo riferimento all’intelligenza artificiale, ma sarebbe più corretto parlare di intelligenza artificiale generativa.

L’intelligenza artificiale, detta anche AI o IA, ha come obiettivo la realizzazione di sistemi in grado di simulare il funzionamento dell’intelligenza umana. E il termine intelligenza artificiale può dunque venire utilizzato per descrivere diverse forme di machine learning.

L’intelligenza artificiale generativa ha invece l’obiettivo di creare contenuti inediti a partire dalle informazioni con cui il sistema è stato addestrato. O magari partendo da input dell’utente, generalmente forniti sotto forma di prompt scritti.

Esistono almeno tre principali macro-categorie di intelligenza artificiale generativa: I Generative Adversarial Networks, i Variational Autoencoder e i modelli Transformer.

Esistono diverse categorie di intelligenza artificiale generativa, che però portano sempre alla creazione automatica di un contenuto inedito.

I Generative Adversarial Networks, o GAN, utilizzano due reti neurali: il generatore e il discriminatore, con il compito di sviluppare contenuti inediti a partire da contenuti preesistenti e di distinguere i dati generati da quelli preesistenti.

I Variational Autoencoder, o VAE, generano l’output inedito a partire da un input. Mentre i modelli Transformer, o modelli di trasformatore, si distinguono per via dei grandissimi set di dati a partire da cui vengono addestrati.

Le applicazioni dell’intelligenza artificiale generativa sono molteplici e, con ogni probabilità, sono ancora tutte da esplorare. Queste potenzialità vanno però di pari passo con rischi da non sottovalutare.

Uno su tutti quello legato al deepfake, ovvero la possibilità di riprodurre l’aspetto di qualcuno senza il suo consenso. Il deepfake è una pratica già di per sé controversa, che diventa ancora più pericolosa nel momento in cui venga applicata per dare risalto a fake news o a notizie tendenziose.

Per approfondimento: Cos’è l’intelligenza artificiale generativa

-

14. AutoGPT, cos'è e come funziona

Rokas Tenys / Shutterstock.com

ChatGPT è un chatbot AI che realizza contenuti inediti a partire da input dell’utente, scritti utilizzando il linguaggio naturale e caricati sotto forma di prompt.

AutoGPT è un’applicazione che porta il concetto di intelligenza artificiale generativa a uno step successivo e che non richiede l’inserimento manuale di prompt.

Con AutoGPT gli utenti eseguono liberamente i modelli di linguaggio alla base dei tool AI e il sistema va oltre la classica interazione fatta di richieste e risposte. Ciò vuol dire che il sistema è in grado di svolgere autonomamente anche mansioni o compiti che non gli siano stati chiesti direttamente.

AutoGPT è un’applicazione open source sviluppata a partire dal GPT-4, il Large Language Model targato OpenAI, alla base sia di ChatGPT che di tanti altri tool di intelligenza artificiale generativa disponibili sul mercato.

AutoGPT supera tutti gli step intermedi tipici del tool AI, portando l’utente nella nuova dimensione dell’intelligenza artificiale generale AGI.

Le capacità di AutoGPT sembrano già impressionanti. Basti pensare che il tool, di fronte a un prompt generico come “elabora una ricetta creativa per una festa in arrivo”, ha scelto autonomamente sia la data da celebrare che il piatto. Terminando le operazioni in meno di due minuti.

Questo semplice esempio aiuta a capire quanto AutoGPT sia in grado di andare oltre i piccoli step e gli obiettivi intermedi che caratterizzano tante altre interazioni con chatbot simili.

Il sistema infatti ha compreso al punto tale la richiesta, da non avere bisogno di ulteriori indicazioni per effettuare diverse ricerche sul web, grazie a cui ha individuato la data e la ricetta che riteneva migliori.

Questo salto di qualità di AutoGPT sta portando alcuni esperti del settore a parlare di una nuova forma di intelligenza artificiale generale, rappresentata anche con l’acronimo AGI.

Per approfondimento:AutoGPT, cos'è e come funziona -

15. Robot umanoidi con intelligenza artificiale, nuova frontiera del lavoro?

Shutterstock

Tutti gli utenti preoccupati che l’intelligenza artificiale possa rubare il lavoro all’essere umano, probabilmente non accoglieranno con grande entusiasmo le notizie relative ai robot umanoidi AI.

Diverse società sono al lavoro per lo sviluppo di robot umanoidi, costruiti a partire da un cervello con funzionalità di intelligenza artificiale. Si pensi in tal senso al progetto Atlas di Boston Dynamics, ma anche alle attività di Engineered Arts e di Hanson Robotics.

I pro dei robot umanoidi con di intelligenza artificiale appaiono palesi già da oggi: si tratterebbe infatti di macchine instancabili, in grado di eseguire compiti ripetitivi praticamente senza possibilità di errore.

I robot umanoidi dotati di intelligenza artificiale potrebbero sostituire il lavoro dell'essere umano, ma questa non è necessariamente una buona notizia.

Per non parlare poi del fatto che, parallelamente, il robot umanoidi saranno sempre più in grado di muoversi e agire in maniera simile a quella dell’essere umano “tradizionale”: si pensi in tal senso alla capacità di salire le scale o a quella di sollevare pesi.

Infine i robot umanoidi potrebbero addirittura superare l’essere umano anche dal punto di vista cognitivo: soprattutto se si realizzasse e prendesse piede lo standard della cosiddetta AGI, o intelligenza artificiale generale.

Da questo punto di vista gli esperimenti recenti di OpenAI sono semplicemente impressionanti: basti pensare che l’azienda dietro la realizzazione di ChatGPT ha già sviluppato robot umanoidi in grado di risolvere il celebre cubo di Rubik utilizzando una mano sola.

La possibilità tecnica di realizzazione dei robot umanoidi va però di pari passo con una serie di riflessioni etiche che vedono coinvolta l’intera comunità scientifica internazionale. E che si interrogano su quanto sia auspicabile una società che potrebbe finire per non avere più bisogno di lavorare.

Per approfondimento: Robot umanoidi con intelligenza artificiale, nuova frontiera del lavoro?

-

16. Come utilizzare Midjourney per l'UI/UX

.jpg)

cfalvarez / Shutterstock.com

L’utilizzo base di Midjourney AI ha a che vedere con la generazione di immagini a partire da prompt testuali, ma il tool permette di eseguire tante altre operazioni. Ad esempio la sua intelligenza artificiale può essere utilizzata nell’ambito del design di User Interface (UI) e User Experience (UX).

In informatica la UI è semplicemente l’interfaccia grafica di una pagina piuttosto che di un sito web. Si tratta dunque di tutti gli elementi con cui l’utente interagisce: a partire dal contenuto testuale letto o l’elemento grafico visto, fino ad arrivare a pulsanti, collegamenti ipertestuali e CTA.

La UX definisce invece l’esperienza utente nel suo complesso. Da un certo punto di vista è inevitabilmente conseguenza della UI, ma viene indirizzata anche da tanti altri elementi che non hanno niente a che vedere col design: ad esempio la disponibilità del prodotto o del servizio che si desidera acquistare. Ma anche la quantità di passaggi che caratterizzano la registrazione piuttosto che le transazioni.

Midjourney AI permette di creare immagini perfette per migliorare UI e UX sul web, così come permette di creare mockup più completi e complessi.

Se si vuole utilizzare Midjourney AI per UI e UX, bisogna partire da prompt specifici, che è bene caricare in lingua inglese. In linea di principio si comincia con il comando “/imagine”, per poi entrare nel merito di parametri quali “-aspect ratios” e “-quality”. In questo modo l’utente ha modo di intervenire sulle proporzioni delle immagini da creare, ma anche sul livello di realismo dell’output definitivo.

Midjourney permette di combinare più immagini tra loro per realizzarne di nuove, così come permette di creare dei loghi e addirittura dei veri e propri mockup. Anche in questo caso è possibile utilizzare dei prompt base, come quello che segue: “/imagine prompt: UI/UX design of [SCENE DESCRIPTION], for [APP/ WEBSITE/ TABLET/YOUR CASE], [STYLE (MODERN/MINIMALISM/URBAN)], [COLOR PALETTE], PARAMETERS --V5”.

Per approfondimento: Come utilizzare Midjourney per l'UI/UX

-

17. Come riconoscere un'immagine generata dall'intelligenza artificiale

Shutterstock

In questo momento storico l’intelligenza artificiale permette di creare immagini a partire da una semplice richiesta scritta. Le potenzialità dei tool sembrano ancora tutte da scoprire e il principale limite sembra risiedere nella capacità dell’utente di realizzare un prompt corretto.

Al tempo stesso proprio la qualità (sempre crescente) degli output dell’intelligenza artificiale pone almeno due grandi ordini di problemi: da una parte la necessità di imparare come riconoscere un’immagine generata con l’IA. Dall’altra la necessità più generale di imparare come riconoscere un’immagine fake.

Per fare un esempio concreto: oggi è possibile realizzare con pochi clic un’immagine che ritrae un qualsiasi soggetto in un qualsiasi contesto… Il tutto senza avere minimamente bisogno del suo consenso.

Questo scenario rischia di creare situazioni sgradevoli, se non addirittura pericolose, ragion per cui è molto importante imparare a capire meglio i processi che hanno portato alla generazione di un singolo contenuto.

Esistono diverse strategie che permettono di individuare un’immagine generata con IA e, più in generale, riconoscere un’immagine fake.

Il primo punto da cui partire sono le informazioni testuali correlate all’immagine: didascalie e metadati, ma anche hashtag e commenti. Questi campi spessi contengono richiami espliciti all’uso di strumenti di intelligenza artificiale, che fugano ogni dubbio lato fruitore.

Dopodiché per riconoscere un’immagine generata con IA bisogna spesso andare a caccia di stranezze: piccoli difetti, difficilmente individuabili a uno sguardo superficiale, che però tradiscono la natura “non umana” del contenuto.

Ad esempio è consigliabile prestare particolare attenzione allasimmetria delle diverse componenti dell’immagine, soprattutto nel caso in cui appaiano volti, mani o denti. Infine è possibile è possibile effettuare una ricerca sul web, se non addirittura delle app dedicate proprio a chi vuole imparare come riconoscere un’immagine fake.

Per approfondimento: Come riconoscere un'immagine generata dall'intelligenza artificiale

-

18. Human Generator, come creare immagini di persone con l'AI

Shutterstock

Generare immagini di persone e, più in generale, immagini realistiche è l’obiettivo di moltissimi utenti che si avvicinano ai principali tool di intelligenza artificiale generativa.

Human Generator è un tool di tipo text-to-image che punta proprio sul realismo dei suoi output e su una serie di funzioni ad hoc che permettono di creare immagini di persone in maniera facile e veloce.

Un primo elemento da tenere a mente è che le immagini di persone realizzate con Human Generator sono tendenzialmente sicure. L’intelligenza artificiale del tool fa infatti riferimento a un database di milioni di foto acquisite legalmente, che vengono combinate per generare nuovi soggetti inventati.

Allo stesso tempo l’utente può comunque dialogare con l’AI, andando a inserire volti reali o altri dati da cui partire per generare nuove immagini realistiche. Così come può richiedere modifiche ex post: dal cambio del colore di capelli o di incarnato, all’aumento o la diminuzione dell’età del soggetto.

Human Generator è il tool AI perfetto per generare immagini realistiche e creare nuove immagini di persone in maniera facile, rapida e sicura.

Nel caso in cui l’utente chieda all’AI di realizzare una nuova immagine di persona a partire da una foto reale, deve parallelamente disporre di un consenso scritto del soggetto o dei soggetti ripresi.

Tutte le operazioni possono venire eseguite attraverso comandi particolarmente intuitivi. Human Generator dispone infatti di un pulsante dedicato all’upload manuale di nuove immagini, così come è dotato di un riquadro di nome Add something up, pensato per le modifiche.

Tutti gli interventi sull’output vengono richiesti a partire da prompt: dunque l’utente non deve fare altro che pensare alle modifiche che ha in mente, scriverle e caricarle all’interno del box dedicato.

Human Generator è un tool gratuito, ma per poter utilizzare le immagini generate in ambito commerciale è necessario sottoscrivere uno dei piani di abbonamento a pagamento disponibili.

Per approfondimento: Human Generator, come creare immagini di persone con l'AI

-

19. Applicazioni di Intelligenza Artificiale: il traduttore simultaneo e gli assistenti vocali smart

Shutterstock

Un uso piuttosto apprezzato dell’intelligenza artificiale ha a che fare con tutte quelle app che permettono di interagire con un essere umano in maniera automatica: si pensi in tal senso ai chatbot, specie a quelli utilizzati in ambito di assistenza al cliente.

Ma l’AI è destinata a entrare in maniera sempre più netta in tanti altri processi e servizi legati alla comunicazione: ad esempio potrebbe letteralmente rivoluzionare il modo in cui vengono concepiti traduttore simultaneo e assistenti vocali.

Le app con servizio di traduttore istantaneo sono la soluzione ideale per chiunque debba esprimersi in una lingua che non conosce particolarmente bene. Questo software infatti riconoscono un qualsiasi messaggio caricato e vanno automaticamente a ripensarlo in un idioma a scelta dell’utente.

L’intelligenza artificiale è destinata a rivoluzionare diversi servizi e programmi legati alla comunicazione, come ad esempio traduttore simultaneo e assistente vocale.

Machine learning e intelligenza artificiale possono potenziare il funzionamento di questo genere di traduttore simultaneo da tanti punti di vista: ad esempio permettendo di aumentare a dismisura il numero di lingue disponibili. Ma anche semplificando e velocizzando la procedura di creazione di un singolo messaggio.

Allo stesso modo l’AI sembra in grado di migliorare e ampliare sensibilmente le funzionalità di un assistente vocale: un altro software pensato per riconoscere le richieste dell’utente e attivare tutte le risorse necessarie per soddisfarle.

Grazie a nuove integrazioni con tool di intelligenza artificiale, un assistente vocale come Siri o Alexa potrà capire ancora meglio tutte le sfumature dei messaggi dell’utente. Ma soprattutto sarà in grado di dare risposte complesse e complete, chiamando autonomamente in causa tutte le fonti e i programmi del caso.

Per approfondimento: Applicazioni di Intelligenza Artificiale: il traduttore simultaneo e gli assistenti vocali smart

-

20. Replika, cos'è e come funziona

Shutterstock

L’intelligenza artificiale sta venendo utilizzata per richiedere la realizzazione degli output più disparati: dai riassunti di contenuti preesistenti ai nuovi testi inediti, passando per le immagini e addirittura i video.

Questi usi presuppongono che il chatbot sia semplicemente uno strumento da utilizzare per raggiungere un obiettivo, ma esistono anche casi in cui il fulcro dell’esperienza dell’utente sta proprio nell'interazione con l’AI.

È il caso di Replika, un chatbot definito spesso come “emozionale” che utilizza l’AI per permettere all’utente di dialogare con un amico virtuale piuttosto che un fidanzato virtuale.

Prima di capire come funziona l’app Replika, è utile conoscere la sua storia: l’idea del chatbot è infatti la diretta conseguenza di un lutto improvviso che ha colpito la co-fondatrice Eugenia Kuyda. Da qui l’idea di sviluppare un’app in grado di creare la replica digitale di una persona realmente esistita.

Replika è un raro esempio di app che usa l’intelligenza artificiale generativa per stabilire una connessione profonda con i suoi utenti.

La caratteristica peculiare di Replika è che ottiene le informazioni di cui ha bisogno direttamente dai suoi utenti. In altre parole il dialogo col chatbot permette al sistema di costruire un amico virtuale o un fidanzato virtuale sempre più in linea con i bisogni dell’interlocutore in carne e ossa.

Questo presupposto permette di entrare nel merito di un altro aspetto significativo di Replika, più complicato da immaginare a un primo sguardo. L’app infatti, più che sviluppare repliche più o meno fedeli di persone esistenti o esistite, entra in dialogo profondo con l’utente: comprende le sue necessità e le utilizza per stabilire una connessione emotiva sempre più sviluppata.

La lingua è chiaramente un aspetto di vitale importanza per la realizzazione di un’esperienza positiva con Replika e, in tal senso, è importante sottolineare che le prime versioni dell’app disponibili sul mercato non supportano l’italiano.

Per approfondimento:Replika, cos'è e come funziona

-

21. Come funzionano i Large Language Models

Shutterstock

I Large Language Models, o LLM, sono dei modelli linguistici di grandi dimensioni. I LLM applicati all’intelligenza artificiale permettono di istruire il sistema alla comprensione del linguaggio naturale: sono dunque lo scheletro su cui vengono costruiti tool come ChatGPT, Gemini o Copilot.

L’idea di sviluppare dei modelli di linguaggio per istruire le macchine è stata teorizzata addirittura negli anni ’30 del XX secolo: non a caso il primo computer conversazionale della storia è datato 1967.

Volendo fare riferimento a modelli più recenti, è possibile citare word2vec del 2013: un algoritmo di elaborazione del linguaggio naturale (NLP), che converte le parole in vettori, ovvero matrici di numeri.

Detto ciò la comunità scientifica concorda nel considerare BERT il primo LLM della storia: un large language model realizzato dal team di Google nel 2019, pensato per aiutare il suo motore di ricerca a comprendere meglio le richieste degli utenti.

I Large Language Models, o LLM, alimentano i diversi tool di intelligenza artificiale con grandi o grandissime quantità di informazioni.

Il cuore pulsante dei LLM sono le informazioni che contengono: dati che servono all’addestramento della macchina e che possono variare di caso in caso. Ad esempio un tool di IA come ChatGPT è stato addestrato fondamentalmente con contenuti testuali. Al contrario un tool di IA come DALL-E è stato addestrato anche con immagini.

Le informazioni contenute nei large language models non vengono però apprese in quanto tali: al contrario vengono frazionate in piccole unità di nome token. Anche perché i tool di intelligenza artificiale non entrano nel merito della comprensione di un’informazione, così come la intende un essere umano.

Piuttosto analizzano la disposizione dei token e la confrontano con quella di tutti i token “simili” all’interno del loro database, per elaborare previsioni grazie a cui forniscono una risposta statisticamente in linea con la richiesta fornita dall’utente.

Per approfondimento: Come funzionano i Large Language Models

-

22. Applicazioni di Intelligenza Artificiale: salute e benessere - health app, l'IA in medicina, sviluppo nuovi farmaci, farmaci intelligenti

Shutterstock

Parlare di intelligenza artificiale, salute e benessere significa tirare in ballo perimetri anche molto diversi tra loro: dallo sviluppo di farmaci intelligenti a quello di nuove health app, passando per la predizione di malattie e, più in generale, il rapporto tra diagnosi e intelligenza artificiale.

La capacità dell’intelligenza artificiale di elaborare grandi quantità di dati, tanto in ottica analitica quanto previsionale, porterà ad app per la salute sempre più performanti, capaci di ricostruire a tempo di record il profilo del paziente.

Ma anche di monitorare costantemente il suo stato di salute tramite wearable e device vari, tenendo conto dei parametri più disparati: ad esempio la frequenza cardiaca, piuttosto che il valore dell’insulina nel sangue.

L’intelligenza artificiale permetterà di ottenere nuovi successi in ambito salute e benessere: dallo sviluppo di farmaci intelligenti ed health app alla predizione delle malattie.

A ciò si aggiunge una nuova idea di diagnosi che, grazie all’intelligenza artificiale, andrà sempre più verso la predizione delle malattie: il tutto partendo semplicemente da una lettura attenta e incrociata dei diversi dati che possono essere raccolti durante una visita.

Infine AI e machine learning stanno venendo utilizzati con successo nello sviluppo di nuovi farmaci intelligenti, mirati alla cura di malattie sempre più specifiche, in un’ottica di vera e propria personalizzazione della cura.

A ciò si aggiunge tutto quello che, più in generale, l’intelligenza artificiale può fare per ottimizzare la filiera farmaceutica nel suo insieme: ad esempio velocizzando e digitalizzando i processi, andando parallelamente a ridurre se non addirittura eliminare il margine di errore figlio dell’intervento umano.

Per approfondimento: Applicazioni di Intelligenza Artificiale: salute e benessere - health app, l'IA in medicina, sviluppo nuovi farmaci, farmaci intelligenti

-

23. Che cos'è l'intelligenza artificiale multimodale e a cosa serve?

.jpg)

Shutterstock

Quando si parla di intelligenza artificiale multimodale si fa riferimento a una particolare IA che possa venire utilizzata in più modi e in più contesti. Un’IA capace di recepire diverse tipologie di informazione dall’utente e, allo stesso tempo, in grado di generare diverse tipologie di output.

Per provare a dare tangibilità al concetto di intelligenza artificiale multimodale, si può pensare alla possibilità di interagire con un unico chatbot per ottenere testi scritti, immagini, codice o video.

Ma le potenzialità di questa IA sono molto più grandi di quanto non si potrebbe immaginare. Ad esempio l’intelligenza artificiale multimodale potrebbe rivoluzionare gli assistenti virtuali così come sono intesi oggi.

L’intelligenza artificiale multimodale amplia le potenzialità dei chatbot, mettendoli nella condizione di ricevere e offrire diverse tipologie di informazione.

I vari Siri e Alexa si trasformerebbero in tool AI avanzati, in grado di eseguire centinaia, se non addirittura migliaia di richieste differenti, integrandosi alla perfezione con le componenti hardware disponibili: dalla telecamera dello smartphone, agli eventuali sensori IoT distribuiti all’interno dello spazio fisico circostante.

In un futuro non troppo lontano l’intelligenza artificiale multimodale spazierà tra gli ambiti e i settori più disparati: dalla salute all’intrattenimento, passando per la produttività e le varie operations aziendali.

Inoltre già oggi esistono diversi esempi, più o meno avanzati, di intelligenza artificiale multimodale. È il caso di Gemini, l’AI targata Google che succede a Bard e sembra già in grado di dialogare alla perfezione con molteplici software.

Ma anche di ChatGPT di OpenAI, soprattutto nel momento in cui si utilizza il large language model GPT-4. Attenzione poi ad Apple, che sembra ormai pronta a presentare la sua idea di AI che, con ogni probabilità, avrà spiccate caratteristiche multimodali.

Per approfondimento: Che cos'è l'intelligenza artificiale multimodale e a cosa serve?

-

24. Applicazioni di Intelligenza Artificiale: marketing & vendite - conosci il tuo cliente

Shutterstock

Al giorno d’oggi tantissime aziende utilizzano tool o applicazioni di intelligenza artificiale per migliorare i processi legati agli ambiti di marketing e vendite.

L’aspetto più interessante è che ormai queste soluzioni vengono applicate tanto alla dimensione live (ad esempio in un negozio fisico) quanto a quella online (ad esempio in un e-commerce). Si pensi in tal senso alla tecnologia beacon, al riconoscimento facciale e alla Radio Frequency Identification, anche nota come RFID.

La tecnologia beacon sfrutta la connettività bluetooth e permette di individuare dispositivi che si trovano all’interno di un raggio di azione variabile da un minimo di circa 10 centimetri a un massimo di circa 70 metri.

Anche la Radio Frequency Identification (RFID) è una tecnologia di identificazione automatica, che permette di scambiare informazioni semplicemente avvicinando i device che contengono un RFID Tag, o transponder, e quelli che contengono un RFID Reader, o interrogatore.

L’intelligenza artificiale è una magnifica alleata di marketing e vendite, specie se integrata con tecnologie come beacon, RFID e riconoscimento facciale.

Infine il riconoscimento facciale consente l’identificazione univoca di una persona attraverso una telecamera, senza che l’utente debba autenticarsi inserendo password, codici o credenziali di sorta.

Integrando queste soluzioni con l’intelligenza artificiale è possibile sviluppare considerevolmente il livello di conoscenza del proprio target. Per poi elaborare strategie di vendita più efficaci.

Si pensi ad esempio al proximity marketing e alla possibilità di inviare automaticamente messaggi a tutti i clienti profilati che si trovano in una particolare posizione geografica.

Ma anche alla possibilità di utilizzare il riconoscimento facciale per accedere a profilazioni sempre più avanzate, grazie agli algoritmi di AI. E alla possibilità conseguente di pianificare customer journey altamente personalizzati.

Per approfondimento: Applicazioni di Intelligenza Artificiale: marketing & vendite - conosci il tuo cliente

-

25. Intelligenza artificiale e Natural Language Processing

Shutterstock

Il principale obiettivo dell’intelligenza artificiale è simulare i processi cognitivi che caratterizzano l’intelligenza dell’essere umano: a partire dalla possibilità di sviluppare ragionamenti complessi, fino ad arrivare alla capacità di imparare dagli errori.

Il Natural Language Processing, anche noto sotto forma di acronimo NLP, può essere considerato una branca dell’intelligenza artificiale, con un compito molto più specifico: realizzare degli algoritmi legati alle diverse attività che permettono ai tool AI di processare il linguaggio naturale.

Il Natural Language Processing viene generalmente distinto in tre filoni. Il primo è quello del Natural Language Understanding (NLU) e ha a che fare con la comprensione del testo scritto dall’utente.

Il Natural Language Processing prevede diversi algoritmi che permettono di comprendere e processare il linguaggio naturale dell’essere umano.

Il secondo è quello della Natural Language Generation (NLG) e ha a che fare con la creazione di testi in linguaggio naturale da parte dell’intelligenza artificiale. Il terzo è quello dell’analisi del sentiment, che si sofferma sulle emozioni positive, negative o neutre che possono essere correlate a un determinato testo.

L’evoluzione dell’NLP aiuta a capire la capacità sempre crescente dei chatbot AI di comprendere le richieste dell’utente, andando a cogliere persino le sfumature inespresse letteralmente.

Allo stesso tempo il Natural Language Processing non va confuso con la SAI, o intelligenza artificiale semantica. Il primo si concentra sulla struttura del linguaggio, dal punto di vista grammaticale e sintattico. La seconda invece si basa soprattutto su semantica e inferenza logica, per entrare nel merito di un significato più ampio.

NLP e SAI collaborano alla realizzazione delle intelligenze artificiali conversazionali, che possono inoltre contare sul machine learning in modo da migliorare il loro livello di comprensione del linguaggio naturale interazione dopo interazione.

Per approfondimento: Intelligenza artificiale e Natural Language Processing

-

26. Riconoscimento Facciale: come funziona e a cosa serve?

Shutterstock

Per capire davvero come funziona il riconoscimento facciale oggi, potrebbe essere necessario anche avere qualche nozione di AI. L’intelligenza artificiale è infatti parte integrante di molti servizi che garantiscono il riconoscimento di volti, così come si lega ad altri sistemi e processi di autenticazione.

La face detection (ovvero il riconoscimento facciale) è una tecnologia che permette di identificare una persona attraverso l’analisi di una semplice immagine.

L’intelligenza artificiale gioca un ruolo chiave proprio in questa prima fase di riconoscimento, considerato che permette al software di individuare rapidamente la porzione di immagine da analizzare.

Più precisamente l’AI ha spesso il ruolo di separare il pattern del volto da riconoscere dal resto della foto: dunque la separa dallo sfondo, andando inoltre ad eliminare eventuali elementi di disturbo.

Il riconoscimento facciale utilizza soluzioni di intelligenza artificiale per separare il volto da analizzare dagli altri contenuti presenti nell’immagine.

Il riconoscimento facciale può essere applicato tanto a immagini bidimensionali quanto a immagini tridimensionali. Inoltre è possibile parlare sia di riconoscimento facciale da remoto che di riconoscimento facciale online.

In questo momento storico la possibilità di riconoscere persone tramite il volto in maniera univoca viene utilizzata nell’ambito di tanto processi diversi: a partire dai sistemi di videosorveglianza, fino ad arrivare alle diverse modalità di autenticazione a due fattori attualmente disponibili sul web.

La rapidità e l’attendibilità sono sicuramente due dei grandi “pro” di questa procedura. Il principale “contro” è legato alla possibilità di violare eccessivamente la privacy personale.

Si pensi in tal senso all’esperimento fatto da Facebook, poi sospeso, di utilizzare proprio il riconoscimento facciale per individuare persone presenti all’interno di foto pubblicate online.

Per approfondimento: Riconoscimento Facciale: come funziona e a cosa serve?

-

27. Chatbot psicologo, l'IA può essere la risposta ai problemi di salute mentale?

Shutterstock

L’intelligenza artificiale viene utilizzata con successo per velocizzare e semplificare operazioni e processi anche molto diversi tra loro. Ma, nella maggior parte dei casi, l’utente utilizza un chatbot AI per ottenere un output specifico: informazioni, piuttosto che contenuti inediti, realizzati a partire da richieste più o meno dettagliate.

Esistono però alcuni casi di intelligenza artificiale applicata al mondo del supporto emotivo online: è il caso ad esempio del cosiddetto chatbot psicologo, piuttosto che del chatbot empatico.

In entrambi i casi l’utente interagisce con un tool AI non tanto per inseguire un risultato particolare, quanto piuttosto per il piacere del dialogo e l’opportunità di capire qualcosa di più sulle proprie emozioni.

Sia nel caso del chatbot psicologico che in quello del chatbot empatico, l’intelligenza artificiale viene utilizzata al servizio del benessere dell’utente. Ma attenzione a non confonderli con una terapia online.

L’intelligenza artificiale può essere utilizzata per migliorare il supporto emotivo online, ma non va confusa con una terapia vera e propria.

I tool di AI possono sicuramente avere un impatto positivo sull’umore di chi li utilizza e, in certi casi, possono indirizzare l’utente verso un professionista. Ma non sono in grado di comprendere il malessere o le esigenze più intime del singolo e, di conseguenza, non sono in grado di dare risposte affidabili, credibili ed esaustive.

Detto questo, il tema del rapporto tra intelligenza artificiale e salute mentale è molto complesso e ancora tutto da approfondire. Chissà dunque che, un domani, la tecnologia faccia un salto tale da permettere ai tool AI di fornire a tutti gli effetti supporto emotivo online.

Nel frattempo gli utenti possono comunque utilizzare i chatbot per un primo approccio a determinati argomenti: ad esempio per chiedere informazioni sui temi del benessere personale.

Per approfondimento: Chatbot psicologo, l'IA può essere la risposta ai problemi di salute mentale?

-

28. Come l'intelligenza artificiale rivoluziona la ricerca medica: il progetto Synthema

Shutterstock

L’intelligenza artificiale è in grado di impattare sulla ricerca medica da tanti punti di vista e uno dei più sottovalutati ha a che fare con la gestione e l’utilizzo di dati esistenti.

Più precisamente dei dati clinici, che oggi sono molto difficili da trattare per almeno due ordini di motivi: da un lato la complessità di reperire informazioni univoche e organiche, soprattutto quando si entra nel merito di malattie rare; dall’altro la necessità di tutelare la privacy del paziente.

Ma un nuovo progetto finanziato dalla Commissione Europea potrebbe cambiare le carte in tavola. Il riferimento è a Synthema, che punta a sviluppare tecniche innovative basate sulla AI, per rendere anonime le informazioni sensibili.

Il progetto Synthema vede la partecipazione italiana delle Università di Bologna e Padova e si sofferma sia sulle informazioni cliniche che su quelle biologiche.

Synthema è il nuovo progetto europeo che usa l’intelligenza artificiale per migliorare la qualità della ricerca medica.

L’anonimizzazione delle informazioni sensibili con l’AI permetterà di sviluppare nuovi dati sintetici, che andranno poi ad alimentare modelli di machine learning.

In questo modo l’intelligenza artificiale potrà utilizzare queste informazioni sviluppando database relazionali e modelli previsionali sulla base di individui “tipo”: non persone in carne ed ossa, ma esempi rappresentativi di uno specifico contesto di gruppo.

Il progetto Synthema prevede che l’AI sfrutti il mix di dati reali e dati sintetici per moltiplicare le informazioni disponibili in un’ottica di ottimizzazione e miglioramento delle performance: sia in termini di risposta a eventuali domande dell’utente, sia in termini di elaborazione di previsioni attendibili.

L’impressione è che questo nuovo uso dell’AI possa rivelarsi decisivo soprattutto nel caso delle malattie rare, spesso caratterizzate da una quantità fin troppo limitata di informazioni a disposizione della comunità scientifica.

Per approfondimento: Come l'intelligenza artificiale rivoluziona la ricerca medica: il progetto Synthema

-

29. IA e gaming, come cambierà il mondo dei giochi

Shutterstock

L’intelligenza artificiale sta sviluppando un rapporto sempre più profondo tanto col mondo del lavoro, quanto con quello dell’intrattenimento e il gaming non fa certamente eccezione.

L’integrazione crescente dell’AI può rivoluzionare anche il mercato dei videogiochi, permettendo agli sviluppatori di creare titoli sempre più ricchi, complessi e interattivi.

Un primo valido esempio in tal senso riguarda gli NPC, ovvero i Non-Playable Character: personaggi non giocabili che popolano soprattutto i giochi di ruolo e i giochi di tipo open world.

Ad oggi gli NPC sono animati da un database variabile di frasi e di reazioni, che devono essere programmate manualmente. Ma, con l’intelligenza artificiale, potrebbero reagire dinamicamente in base alle azioni dell’utente e ad altre eventuali variazioni di scenario.

L’intelligenza artificiale può rivoluzionare il mondo del gaming, portando a videogiochi sempre più ricchi e “personalizzati”.

Un’altra integrazione interessante di IA e gaming permetterebbe di superare un ulteriore limite strutturale noto agli appassionati: la disponibilità di un determinato numero di lingue di gioco.

Con un tool AI, il problema potrebbe essere risolto in pochi clic. E così i videogame potrebbero ottenere rapidamente tutte le lingue che i giocatori desiderano: sia dal punto di vista delle voci di menù scritte, sia da quello del doppiaggio.

Infine due suggestioni oggi teoriche, ma tecnicamente possibili. L’intelligenza artificiale potrebbe garantire esperienze di gaming personalizzate e “uniche”: questo potrebbe voler dire abbandonare per sempre l’idea di due partite uguali tra loro, ma non solo.

L’AI infatti è potenzialmente in grado di permettere ai videogiochi di rigenerarsi e reinventarsi costantemente. In altre parole, grazie all’intelligenza artificiale l’utente potrebbe trovarsi di fronte a un gioco che crea autonomamente nuove situazioni e che, di fatto, non finisce mai.

Per approfondimento: IA e gaming, come cambierà il mondo dei giochi