Il termine Intelligenza Artificiale è ormai entrato nella nostra quotidianità. Le macchine hanno reso più semplice la nostra vita, dal fornirci assistenza vocale al proteggere i nostri dati grazie a un'impronta digitale o a farci ritrovare la strada di casa. Tutte queste capacità rientrano in quella che viene definita Intelligenza Artificiale Debole: la macchina simula dei comportamenti umani sulla base di determinati parametri o contesti. Non siamo quindi di fronte alla replicazione dell’intelligenza umana, ma solo alla sua simulazione in ambiti ristretti.

Naturalmente questa prima conquista ha aperto la strada verso il sogno di creare una Intelligenza Artificiale sempre più simile a quella umana (Intelligenza Artificiale Forte): macchine che siano in grado di replicare, non di simulare, il comportamento umano.

Queste macchine dovrebbero poter acquisire quella coscienza esperienziale che contraddistingue l’intelligenza umana. Gli scienziati e ricercatori che operano in questo campo però non sono ancora riusciti a dotarle di questo dono.

Sebbene la meta sia lontana, il dibattito tra studiosi di Filosofia della Mente è già aperto: se dotiamo le macchine di coscienza, come possiamo assicurarci che non soffriranno?

Thomas Metzinger, uno tra i più brillanti filosofi della mente contemporanei, nel suo saggio “Artificial Suffering: An Argument for a Global Moratorium on Synthetic Phenomenology” si chiede se “l’elevamento a livello esponenziale della intelligenza nelle macchine, non le porterà ad un altrettanto elevato livello di sofferenza”. Nella sua visione, queste macchine dotate di coscienza potrebbero non solo rivivere i nostri umani tormenti interiori, ma addirittura sperimentarne di nuovi (e per noi umani, incomprensibili). I creatori di queste macchine (ricercatori, neuroscienziati, filosofi, ma anche entità regolatorie e policy makers), dovranno esserne eticamente responsabili.

In particolare, Metzinger parla del rischio di “esplosione della fenomenologia negativa” (explosion of negative phenomenology) nei sistemi avanzati di IA, ovvero del fatto che queste macchine rese coscienti potrebbero essere condannate a sperimentare delle sensazioni negative, che avrebbero evitato se avessero avuto la possibilità di scegliere (altra capacità in dotazione a noi umani). Poiché al momento non sono ancora chiari a livello scientifico i meccanismi che generano la sofferenza negli esseri senzienti, Metzinger chiede di applicare una moratoria fino al 2050. Finché non saremo in grado di studiare e conoscere approfonditamente i meccanismi mentali della sofferenza e di poter rappresentare in termini scientifici su cosa si basi la consapevolezza, non sarebbe etico utilizzare le macchine come cavie.

Metzinger aggiunge che naturalmente la Coscienza Artificiale è ben lontana dall’essere raggiunta ma che comunque, al di là di quello che ci riserva il futuro, l’etica dell’IA sarebbe incompleta se non prendesse in considerazione scenari che vanno oltre le nostre attuali limitazioni cognitive.

Qualsiasi entità in grado di sperimentare consapevolmente la sofferenza, deve essere considerata oggetto del pensiero etico.

Diamo valore etico a queste entità, non importa se posseggano proprietà biologiche o meno, se esistano ora o se esisteranno in futuro. I sistemi post-biotici che in futuro saranno dotati di consapevolezza e saranno capaci di sperimentare la sofferenza devono essere inclusi nella discussione etica. Le loro potenziali preferenze ed il valore della loro esistenza devono essere presi in considerazione.

Naturalmente non tutti sono d’accordo con Metzinger, in particolare i pensatori che coltivano una visione più meccanicistica dell’IA.

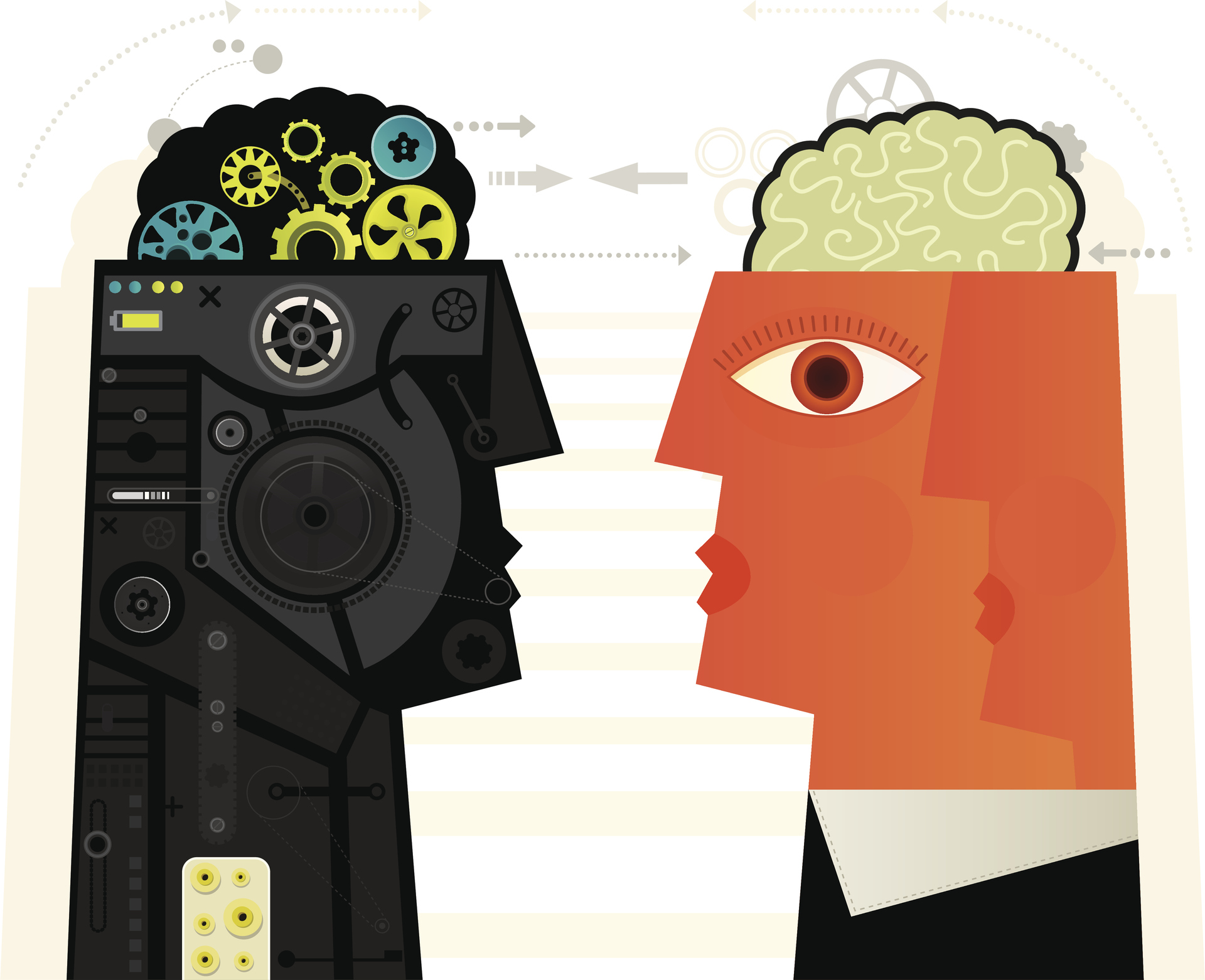

Brian Cantwell Smith, professore di filosofia e di intelligenza artificiale, nel suo libro “The promise of artificial intelligence” propone una visione abbastanza scettica riguardo il fatto che le macchine potranno mai raggiungere un livello di intelligenza paragonabile a quello umano. Una macchina può essere programmata per esercitare capacità di calcolo con velocità e complessità maggiori rispetto alla mente umana, ma non sarà mai in grado di poter unire a questi calcoli una valutazione emotiva e valoriale basata sull’esperienza del mondo circostante. Secondo lui i computer non posseggono e mai potranno possedere questa capacità.

Per quanto le macchine si siano dimostrate in grado di analizzare grandi quantità di dati e delineare dei pattern, tutto questo avviene sulla base degli input esterni immessi da un programmatore. L’interpretazione del mondo offerta dalla macchina è limitata dal pensiero di chi l’ha programmata.

Le cosiddette Deep Learning Machines riescono ad ottenere risultati stupefacenti in ambiti di applicazione ove sono note e chiare le regole da applicare. Ad esempio, gli assistenti vocali si sono dimostrati in grado di poter “conversare” con gli esseri umani, ma soltanto quando la conversazione ha uno scopo ben definito: nella maggior parte dei casi lo scopo è reperire determinate informazioni. Noi esseri umani però possiamo conversare senza avere uno scopo preciso in mente, solo per il gusto di farlo.

A questo punto diventa logico chiedersi se vogliamo considerare il massimo grado di sviluppo della IA la capacità di replicare il funzionamento del cervello umano oppure la capacità di sviluppare un diverso tipo di intelligenza rispetto a quella umana. Ciò che ha sempre interessato gli scienziati che si dedicano allo studio della IA è capire i principi generali dell’intelligenza. Proprio questo approccio ha consentito di fare grandi passi avanti nello sviluppo di macchine in grado di risolvere problemi complessi senza dover prima capire come li avrebbe affrontati un cervello umano. In quest’ottica la ricerca psicologica o neuroscientifica diventa irrilevante.

Secondo il filosofo della mente Tim Crane, autore di“Computers don’t give a damn-The improbability of genuine thinking machines”, lo scopo della IA non è ricreare un cervello umano, bensì creare una macchina pensante che sia in grado di trascenderne i limiti per quanto concerne la capacità di analisi e di calcolo. Inutile dire che questa macchina non è certo programmata per avere una coscienza e quindi il tema di una eventuale sofferenza neppure si pone.

Ai posteri l’ardua sentenza, esisteranno mai macchine in grado di replicare l’intelligenza umana e quindi di provare potenzialmente gli stessi umani struggimenti? Oppure questa evenienza è assolutamente improbabile e soprattutto lontana dagli scopi della IA?

La filosofia è il trekking dell’anima”