In Breve (TL;DR)

- Anthropic ha aggiornato le sue politiche: dal 28 settembre 2025 i dati degli utenti – comprese chat e sessioni di coding su Claude – potranno essere usati per addestrare l’AI e conservati fino a cinque anni. L’utente può comunque scegliere di rifiutare il trattamento dei propri dati personali.

- Per disattivare l’utilizzo dei dati, basta accedere alle impostazioni di Claude, selezionare “Privacy” e disattivare l’interruttore “Aiuta a migliorare Claude”. La scelta vale solo per i dati futuri e non si applica ai piani aziendali o istituzionali.

L’intelligenza artificiale, per poter funzionare correttamente, deve essere addestrata su una grande quantità di dati. Dati che Anthropic ha deciso di reperire, almeno in parte, direttamente dagli utenti che utilizzano le sue soluzioni, tra cui Claude.

Anthropic ha modificato le politiche di utilizzo, gestione e conservazione dei dati, introducendo la possibilità di utilizzare le informazioni condivise dagli utenti per rendere la sua AI sempre più performante. Una decisione non da tutti gradita e che preoccupa coloro che pongono maggiore attenzione alla tutela della propria privacy e dei dati personali.

C’è, però, una buona notizia: il controllo resta nelle mani dell’utente. Anthropic offre la possibilità ad ogni utilizzatore del servizio di scegliere se consentire l’utilizzo dei suoi dati o evitare che ciò accada. Scopriamo cosa sta cambiando e come modificare le impostazioni per il trattamento dei dati personali.

Anthropic utilizzerà i dati degli utenti per addestrare l’AI, cosa sta cambiando

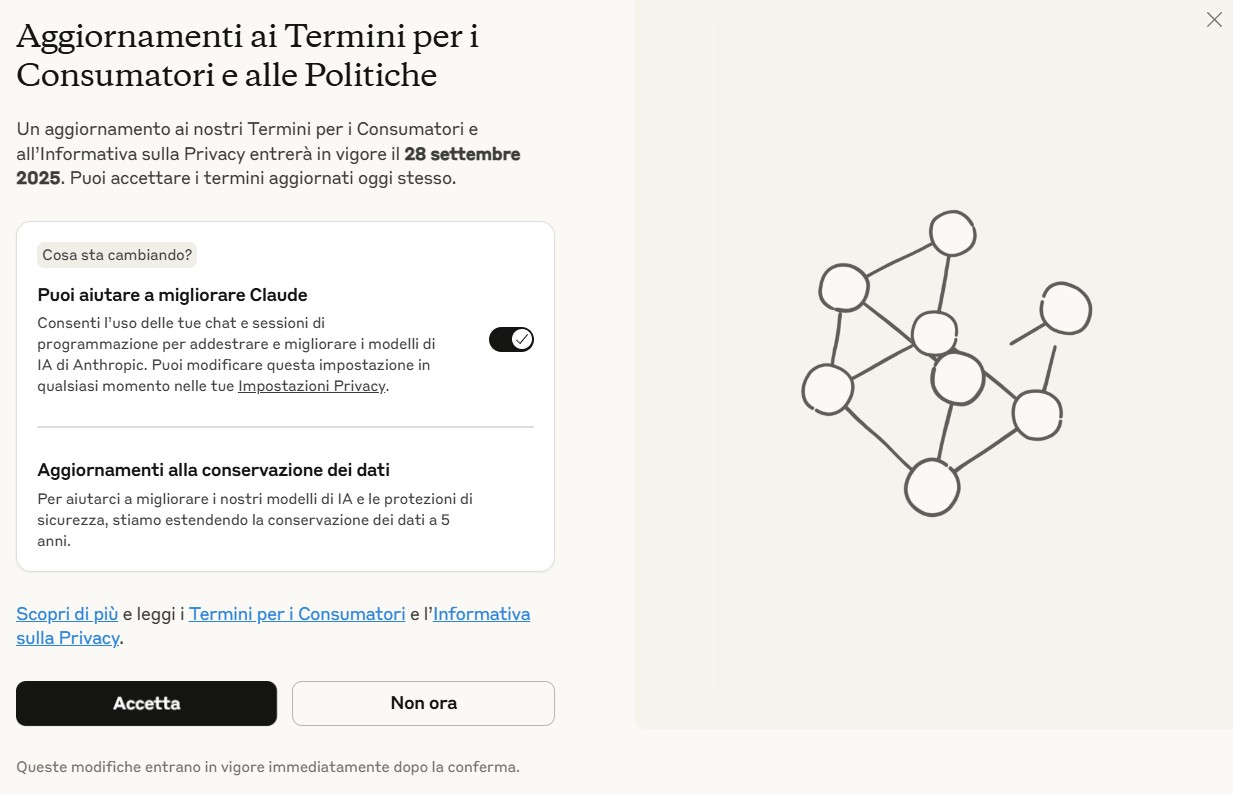

Screenshot Fastweb Plus

Anthropic inizierà ad addestrare i suoi modelli AI con i dati forniti dall’utente, con le chat avviate su Claude e con le sessioni di coding. Inoltre, ha modificato i termini di conservazione dei dati inseriti dati, che ora resteranno memorizzati per ben cinque anni.

Queste nuove regole hanno valore a partire dal 28 settembre2025, ma l’utente può sempre decidere di impedire all’azienda di utilizzare le proprie informazioni, rinunciando alla conservazione dei dati e al loro utilizzo per l’addestramento dei modelli AI. Inoltre, Anthropic ci ha tenuto a tranquillizzare tutti: sono stati inseriti dei filtri che impediscono che i dati sensibili vengano forniti a terze parti.

In ogni caso, nei giorni scorsi gli utilizzatori di Claude hanno ricevuto un avviso, un pop-up in cui venivano dichiarate le nuove regole e in cui era presente un interruttore da disattivare o attivare, impostato automaticamente su ON. Chi ha accettato, ha permesso ad Anthropic di conservare e utilizzare sia le chat e le sessioni di coding future, che quelle avviate in passato semmai un giorno venissero riaperte dall’utente stesso.

I nuovi iscritti, invece, potranno decidere al momento della registrazione. In ogni caso, da dopo il 28 settembre 2025 è obbligatorio scegliere se consentire ad Anthropic di utilizzare i dati o rifiutare.

Tutte le modifiche si applicano ai piani di abbonamento Free, Pro, Max e Claude Code di Claude. Non si applicano, invece, ai piani aziendali e istituzionali, come Claude Work o Claude Education.

Come cambiare le impostazioni per l’utilizzo dei dati per l’addestramento dei modelli AI di Anthropic

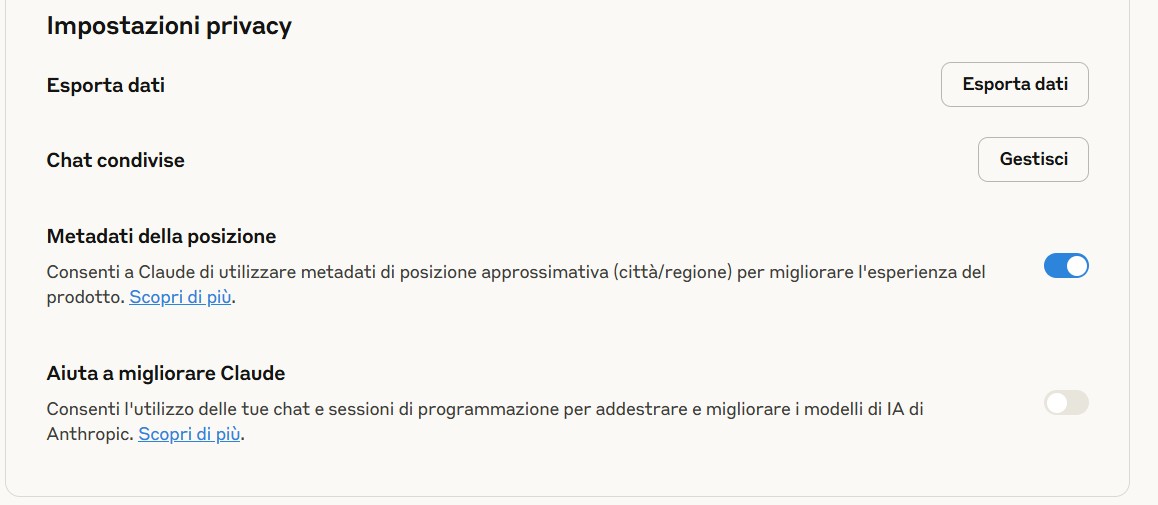

Screenshot Fastweb Plus

Le impostazioni sul trattamento dei dati sono modificabili in qualsiasi momento. Chi ha accettato per errore o chi ha cambiato idea può, quindi, intervenire rapidamente. Tuttavia, è bene essere consapevoli che la decisione riguarderà solo le conversazioni e le informazioni future: quelle già fornite non potranno essere eliminate.

Per modificare la selezione accedere a Impostazioni e, poi, cliccare su Privacy. Nella sezione Impostazione per la privacy, disattivare (o attivare) l’interruttore collocato in corrispondenza della voce Aiuta a migliorare Claude.

Per saperne di più: Claude AI, guida completa al chatbot di Anthropic

Domande frequenti (FAQ)

-

Come posso controllare l'utilizzo dei miei dati da parte di Anthropic?Puoi controllare l'utilizzo dei tuoi dati da parte di Anthropic accedendo alle Impostazioni e selezionando la sezione Privacy. Da lì, potrai attivare o disattivare l'interruttore relativo all'opzione 'Aiuta a migliorare Claude'.

-

Quali sono le novità riguardanti l'addestramento dell'AI da parte di Anthropic?Anthropic inizierà ad addestrare i suoi modelli AI utilizzando i dati forniti dagli utenti, le chat avviate su Claude e le sessioni di coding. Inoltre, i dati verranno conservati per cinque anni e l'utente può scegliere se permettere o meno l'utilizzo di tali informazioni.

-

Le nuove regole si applicano a tutti i piani di abbonamento di Claude?Sì, le nuove regole si applicano ai piani di abbonamento Free, Pro, Max e Claude Code di Claude. Non si applicano, invece, ai piani aziendali e istituzionali come Claude Work o Claude Education.

-

Quando entreranno in vigore le nuove regole riguardanti l'utilizzo dei dati da parte di Anthropic?Le nuove regole riguardanti l'utilizzo dei dati da parte di Anthropic entreranno in vigore il 28 settembre 2025. Da quel momento in poi, sarà obbligatorio per gli utenti scegliere se consentire o rifiutare l'utilizzo dei propri dati.

-

Posso modificare le mie scelte riguardo all'utilizzo dei dati in qualsiasi momento?Sì, puoi modificare le tue scelte riguardo all'utilizzo dei dati in qualsiasi momento. Basta accedere alle Impostazioni, selezionare la sezione Privacy e attivare o disattivare l'interruttore relativo all'opzione 'Aiuta a migliorare Claude'.

-

Cosa succede se decido di non consentire ad Anthropic di utilizzare i miei dati?Se decidi di non consentire ad Anthropic di utilizzare i tuoi dati, l'azienda non utilizzerà le tue informazioni per l'addestramento dei modelli AI. Inoltre, sono stati introdotti filtri per evitare la condivisione di dati sensibili con terze parti.