In Breve (TL;DR)

- I test su Google AI Overview mostrano errori frequenti nelle risposte, con milioni di informazioni imprecise generate ogni ora su larga scala.

- Il limite principale riguarda il collegamento alle fonti e la natura probabilistica delle risposte, che richiede sempre una verifica da parte degli utenti.

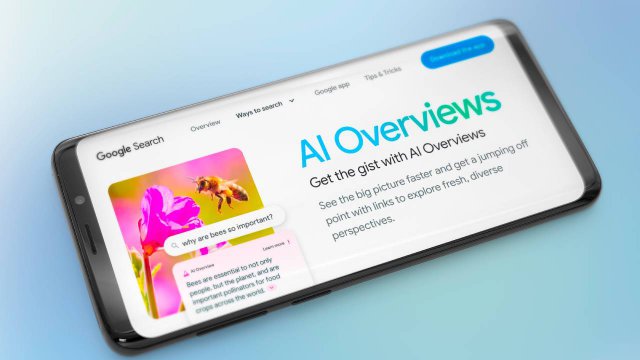

Le risposte fornite da Google AI Overview non sono sempre corrette. È quanto emerge da un'analisi condotta dalla startup AI Oumi su incarico del New York Times, che ha analizzato un campione di risposte generate dall’intelligenza artificiale di Google. Questi riassunti vengono mostrati dal motore in cima alla pagina e prima del classico elenco di link.

Le persone, quindi, tendono a leggerli senza cliccare e approfondire nelle relative pagine web. Si parla infatti del fenomeno zero click. In base ai risultati dello studio gli utenti rischiano di affidarsi a informazioni imprecise e ciò comporterebbe problemi lato sicurezza e credibilità.

Quanto è affidabile Google AI Overview secondo i test

Google AI Overview arriva in Italia nel 2025 e in un anno rivoluziona le abitudini di ricerca online degli utenti. Spesso però la sintesi sbaglia e ciò rende la funzione meno affidabile. L'analisi di Oumi ha testato 4.326 query usando SimpleQA, strumento sviluppato da OpenAI. Secondo i test, con Gemini 2.0 gli AI Overview rispondono correttamente all'85% delle domande, con Gemini 3.0 la percentuale sale al 91%. Numeri che sembrano minimi se non si considera che il motore risponde a oltre 5 trilioni di ricerche all'anno. Ciò significa che gli utenti potrebbero essere esposti a più di 57 milioni di risposte errate ogni ora, quasi un milione al minuto.

Un aspetto critico emerso dall'analisi è il cosiddetto grounding, ovvero la capacità del sistema di collegare le risposte a fonti che le supportino davvero. Con Gemini 2.0 il 37% delle risposte non era supportato da fonti adeguate. Con Gemini 3.0 questa percentuale è salita al 56%: più della metà delle risposte cita fonti che non le verificano o le contraddicono. In alcuni casi un AI Overview errato è immediatamente seguito da un link con l'informazione corretta, in altri una risposta accurata cita una fonte con informazioni sbagliate, in altri ancora le pagine collegate non contengono alcuna informazione rilevante.

Lo stesso Google in un'analisi interna indipendente dalla ricerca ha rilevato che il modello produce informazioni errate nel 28% dei casi. La società ha contestato i risultati dell'analisi Oumi, definendola difettosa e non rappresentativa delle ricerche reali. Vale però la pena notare che Google stesso, nel testo in piccolo degli AI Overview, consiglia agli utenti di verificare le risposte ricevute.

Perché gli AI Overview sbagliano e cosa cambia per gli utenti

Per capire perché questi errori si verificano è utile sapere come funzionano gli AI Overview. Il sistema non cerca e trova la risposta giusta come farebbe un motore di ricerca tradizionale: costruisce una sintesi probabilistica basandosi su grandi quantità di testo, generando una risposta che suona plausibile ma che non è necessariamente accurata. È il fenomeno delle allucinazioni, un limite strutturale dei modelli linguistici di grandi dimensioni che si manifesta in modo più evidente quando le query richiedono dati precisi come date, numeri o fatti storici. Vale anche la pena segnalare un limite metodologico dell'analisi stessa: Oumi ha potuto valutare grandi volumi di risultati solo affidandosi a strumenti AI, che possono a loro volta introdurre errori. Inoltre Google genera a volte risposte diverse per la stessa query, anche ripetuta a pochi secondi di distanza, il che rende difficile una misurazione sistematica e definitiva.

Il problema si amplifica considerando il comportamento degli utenti. Ricerche citate nell'analisi mostrano che solo l'8% degli utenti verifica effettivamente le risposte dell'AI, e che quasi l'80% segue le indicazioni dell'intelligenza artificiale anche quando fornisce risposte sbagliate. Gli AI Overview, presentati con un tono autorevole in una posizione privilegiata nella pagina dei risultati, amplificano questo rischio. Per gli utenti il messaggio è chiaro: i riassunti degli AI Overview non vanno presi come fonte definitiva, soprattutto per informazioni che richiedono precisione. Verificare le fonti citate e consultare i link tradizionali resta un passaggio necessario.

Per saperne di più: Cos’è e cosa si intende per digital marketing

Domande frequenti (FAQ)

-

Quanto sono affidabili gli AI Overview di Google?Secondo diversi test, le risposte sono corrette nella maggior parte dei casi ma possono contenere errori rilevanti, soprattutto su dati precisi.

-

Perché Google AI Overview sbaglia?Perché genera risposte probabilistiche basate su modelli linguistici, che possono produrre contenuti plausibili ma non sempre accurati.

-

Bisogna fidarsi delle risposte AI nei risultati Google?No, è consigliato verificare sempre le fonti e consultare anche i link tradizionali, soprattutto per informazioni sensibili o dettagliate.